第13章:遗忘与因果的较量

兔狲教授的亲切开场

上一章,我们探索了LSTM的记忆链条——通过门控机制实现选择性记忆。但记忆不止一种方式。今天,我们要回答一个关键问题:渐进式记忆与直接访问,哪种更好? 当LSTM的遗忘门与注意力机制的因果关注相遇,会碰撞出怎样的思想火花?让我们慢慢来,探索遗忘与因果的较量。

核心议题:记忆的两种哲学

“教授,”小小猪指着屏幕上两个不同的网络架构,“LSTM通过遗忘门渐进地更新记忆,但注意力机制好像可以直接‘看’到所有历史信息。这两种方式,哪种更聪明?”

中山大学康乐园的冬日午后,阳光透过玻璃窗洒进黑石屋书房,在红砖地上投下温暖的光斑。窗外,几只麻雀在榕树枝头跳跃,叽叽喳喳地讨论着午餐的收获。书房里,功夫茶具上飘着淡淡的热气,墙上的挂钟滴答作响,记录着思想的每一次碰撞。

窗边的小海豹说,“这是个深刻的对比。历史上,人们对记忆机制有两种主要理论:渐进整合与直接访问。LSTM代表前者,注意力机制代表后者。”

兔狲教授轻轻放下茶杯,微笑道:“你们提出了序列建模的核心哲学问题。记忆不是单一的过程,而是多种机制的协作。今天,我们要比较这两种不同的记忆哲学。”

渐进式记忆:LSTM的智慧与局限

小小猪走到白板前,画出LSTM的结构图。

“教授,LSTM通过细胞状态

小海豹补充道:“从认知科学角度看,渐进式记忆像‘工作记忆’——容量有限,需要不断更新。但人类也有‘长时记忆’,可以存储大量信息并直接访问。”

兔狲教授点头:“是的,LSTM的局限在于信息容量和访问效率。”

他在白板上写下LSTM的关键方程:

“看这个更新公式,”他说,“细胞状态

- 信息衰减:即使遗忘门

接近1,信息也会随时间逐渐模糊 - 容量有限:

的维度固定,不能存储无限信息 - 访问间接:要获取早期信息,需要经过多个时间步的传播

小小猪思考着:“所以LSTM像……一本不断重写的日记?每次只更新当前页,但旧页面会逐渐褪色?”

“很形象的比喻,”兔狲教授微笑,“LSTM的渐进式记忆适合处理局部依赖——当前信息与近期历史的关联。但对于长距离依赖,信息需要在时间中‘旅行’很远,可能中途丢失。”

梯度消失的再思考

兔狲教授在白板上画了一个长序列的梯度传播图。

时间步1 ← 时间步2 ← ... ← 时间步100“即使LSTM缓解了梯度消失,”他解释,“梯度在长序列中传播仍然会衰减。更重要的是,误差信号可能被稀释——早期时间步的调整信号被后来的更新覆盖。”

小海豹若有所思:“这就像……在长长的传话游戏中,最初的信息很容易被扭曲?”

“正是,”兔狲教授说,“LSTM的门控机制是精巧的工程解决方案,但可能不是认知的最优模型。人类记忆似乎能够直接访问过去的重要时刻。”

因果关注:注意力机制的革命

窗外天色渐暗,黑石屋里亮起了温暖的灯光。

“教授,”小小猪问,“如果LSTM是‘渐进式记忆’,那注意力机制是什么?”

兔狲教授走到白板前,写下注意力机制的核心思想:

在每个时刻,直接计算与所有历史时刻的相关性

他在白板上画出注意力的示意图:

时刻t的关注:关注时刻1, 时刻2, ..., 时刻t“注意力机制的关键创新,”兔狲教授解释,“是打破时间顺序的束缚。在时刻

小海豹仔细观察示意图:“这就像……拥有完美的记忆力?可以瞬间回忆起任何过去时刻?”

“更准确地说,”兔狲教授纠正,“是选择性回忆。注意力机制计算每个历史时刻与当前时刻的‘相关性分数’,然后加权组合历史信息。”

他在白板上写下缩放点积注意力的公式:

其中:

(Query): 当前时刻的“查询”——想知道什么 (Key): 历史时刻的“键”——有什么信息 (Value): 历史时刻的“值”——具体内容

小小猪认真看着公式:“

“精辟的理解,”兔狲教授赞许道,“注意力机制实现了内容寻址记忆:根据当前内容(

因果注意力的约束

兔狲教授在白板上特别标注“因果”二字。

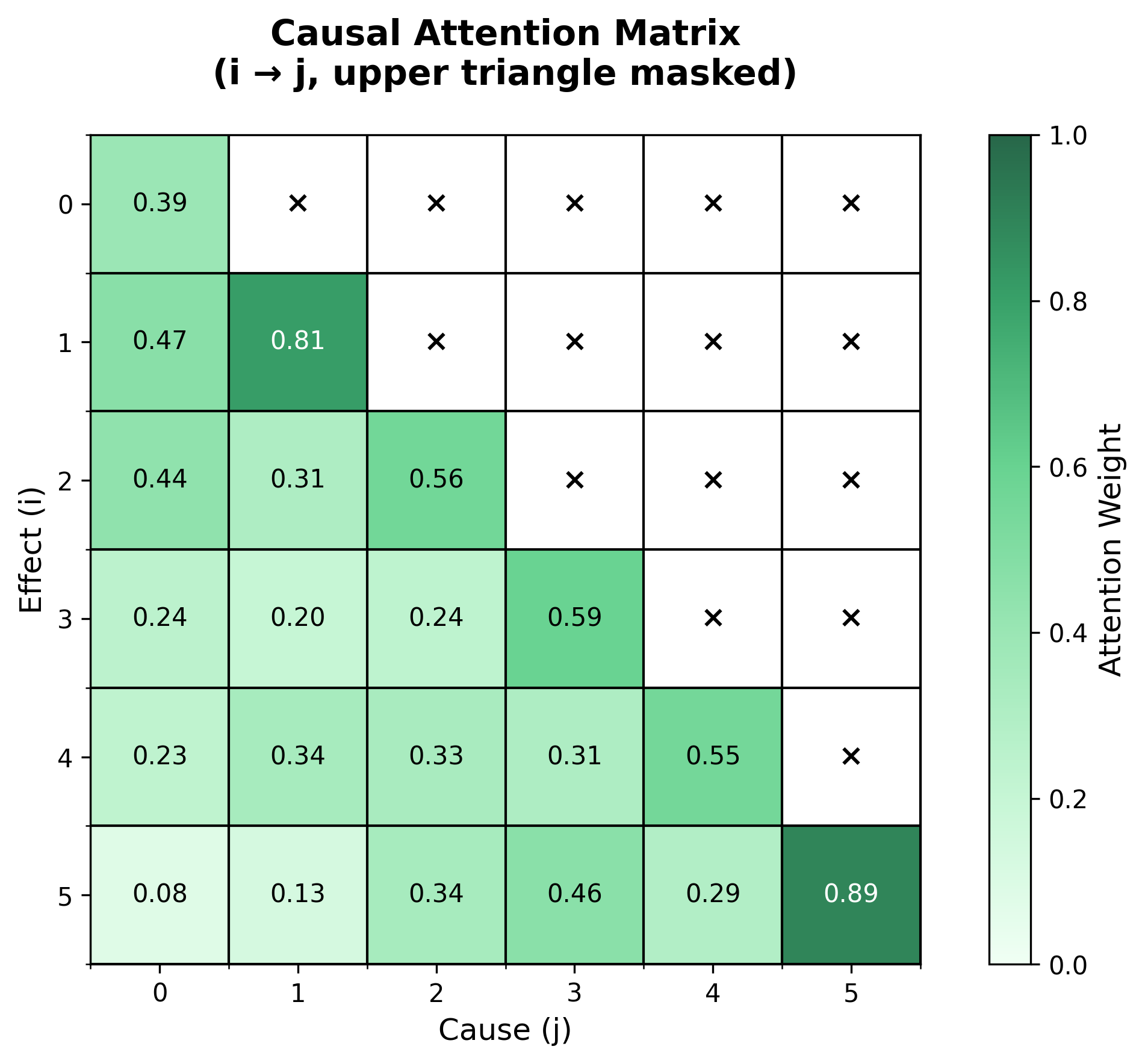

“在序列建模中,”他说,“我们通常使用因果注意力(Causal Attention):时刻

他在注意力矩阵上画了一个下三角:

[• 0 0 0] 时刻1只能看自己

[• • 0 0] 时刻2能看1,2

[• • • 0] 时刻3能看1,2,3

[• • • •] 时刻4能看1,2,3,4

“这种因果约束,”兔狲教授解释,“保证了序列生成的自回归性质:预测下一个词时,只能使用已经生成的词。”

小海豹思考着:“这就像……写作时只能回头看已经写下的内容,不能偷看后面的提纲?”

“很好的比喻,”兔狲教授说,“因果注意力在保持时间顺序的同时,实现了对历史的直接访问。这是它与LSTM的根本区别。”

正交计算图:看见两种记忆的流动

兔狲教授打开投影仪,两幅规整的计算图并排出现在屏幕上。

“左边是LSTM的计算图,”兔狲教授指着图说,“注意细胞状态

“右边是注意力机制的计算图,”他继续说,“注意查询

小小猪比较着两幅图:“LSTM是‘串行流水线’,注意力是‘并行查询’?一个像生产线,一个像搜索引擎?”

“精辟的总结,”兔狲教授微笑,“LSTM的计算是时间递归的:

小海豹若有所思:“这种并行性带来了效率优势?Transformer比RNN/LSTM训练更快?”

“是的,”兔狲教授说,“但更重要的是建模能力的不同。注意力机制能够捕捉任意距离的依赖,不受时间间隔的限制。”

记忆容量的比较

兔狲教授在白板上列出两种机制的容量特性:

LSTM:

- 记忆容量:固定(隐藏状态维度)

- 访问方式:顺序扫描(时间线性)

- 长期依赖:可能衰减

- 并行性:有限(时间递归)

注意力机制:

- 记忆容量:序列长度(理论上无限)

- 访问方式:直接访问(常数时间)

- 长期依赖:完美保持

- 并行性:高度并行

小小猪思考着:“所以注意力机制理论上更强大?但实践中有什么代价?”

“好问题,”兔狲教授说,“注意力的代价是计算复杂度:

思想模型:两种记忆哲学的平衡

小海豹从书架取下一本哲学著作,“教授,这让我想起思想史上的‘经验主义’与‘理性主义’之争。”

“很好的联系,”兔狲教授说,“LSTM像经验主义——知识从经验中渐进积累。注意力像理性主义——通过推理直接把握关系。”

他在白板上写下思想模型:

思想模型:记忆的双重加工

渐进整合(LSTM哲学):

- 信息随时间逐步吸收和更新

- 强调过程与演变

- 适合学习序列中的局部模式和时间动态

直接访问(注意力哲学):

- 根据需要直接提取相关信息

- 强调结构与关系

- 适合捕捉长距离依赖和结构化模式

“这两种机制,”兔狲教授解释,“不是相互排斥,而是互补的。事实上,现代架构如Transformer同时使用了注意力(捕捉长距离依赖)和前馈网络(处理局部模式)。”

小小猪思考着:“所以最好的方案可能是……结合两者?用注意力捕捉大范围结构,用其他机制处理局部细节?”

“正是,”兔狲教授回答,“这就是深度学习的设计智慧:没有银弹,只有权衡。不同的问题需要不同的归纳偏置。”

遗忘的价值与局限

兔狲教授在白板上重点讨论“遗忘”。

“LSTM的遗忘门体现了主动遗忘的智慧,”他说,“但注意力机制的‘完美记忆’也有代价。”

他列出遗忘的利弊:

遗忘的好处:

- 防止过拟合:忘记无关细节,专注核心模式

- 计算高效:不需要存储所有历史

- 防止灾难性干扰:新知识不会完全覆盖旧知识

遗忘的代价:

- 信息丢失:可能忘记重要信息

- 长期依赖困难:早期信息可能完全丢失

- 历史连续性断裂:失去时间演变的完整记录

小海豹补充道:“在认知科学中,遗忘不仅是缺陷,也是认知优化。大脑需要忘记大部分信息,才能专注于重要模式。”

“是的,”兔狲教授说,“LSTM的遗忘门是这种认知优化的计算实现。但注意力机制提出了另一种思路:存储所有信息,但选择性关注。”

关键要点

兔狲教授的总结:记忆哲学的智慧

- 两种记忆范式:LSTM代表渐进式记忆(时间递归更新),注意力代表直接访问记忆(内容寻址访问),体现序列处理的两种根本哲学

- 渐进整合的价值:LSTM通过门控实现选择性记忆与遗忘,适合学习时间动态和局部模式,体现“记忆作为过程”的认知模型

- 直接访问的革命:注意力机制打破时间顺序束缚,实现任意距离的依赖建模,体现“记忆作为关系”的结构化思维

- 因果约束的必要:在序列生成中,因果注意力保证时间顺序性,只能访问过去不能访问未来,维持自回归生成的合理性

- 权衡与互补:没有绝对优越的架构,只有适合问题的归纳偏置,最佳方案往往是多种机制的结合

代码实践:注意力机制的Python实现

"让我们用Python代码来实践注意力机制,"兔狲教授说,"并比较它与LSTM的不同思维方式。"

缩放点积注意力实现

import numpy as np

import matplotlib.pyplot as plt

def scaled_dot_product_attention(Q, K, V, mask=None):

"""缩放点积注意力

参数:

Q: 查询矩阵 (batch_size, seq_len_q, d_k)

K: 键矩阵 (batch_size, seq_len_k, d_k)

V: 值矩阵 (batch_size, seq_len_v, d_v)

mask: 注意力掩码 (可选)

返回:

注意力输出,注意力权重

"""

# 计算点积注意力分数

d_k = K.shape[-1]

scores = np.matmul(Q, K.transpose(0, 2, 1)) # (batch_size, seq_len_q, seq_len_k)

# 缩放

scores = scores / np.sqrt(d_k)

# 应用掩码(如果提供)

if mask is not None:

scores = scores + (mask * -1e9) # 将掩码位置设置为负无穷

# softmax归一化得到注意力权重

attention_weights = softmax(scores, axis=-1) # (batch_size, seq_len_q, seq_len_k)

# 加权求和值向量

output = np.matmul(attention_weights, V) # (batch_size, seq_len_q, d_v)

return output, attention_weights

def softmax(x, axis=-1):

"""稳定的softmax实现"""

x_exp = np.exp(x - np.max(x, axis=axis, keepdims=True))

return x_exp / np.sum(x_exp, axis=axis, keepdims=True)

def causal_mask(seq_len):

"""创建因果注意力掩码(下三角矩阵)

保证位置i只能关注位置j (j <= i)

"""

mask = np.triu(np.ones((seq_len, seq_len)), k=1) # 上三角(不包括对角线)为1

return mask # 1的位置需要被掩码

# 注意力机制演示

print("缩放点积注意力演示:")

print("=" * 60)

# 创建测试数据

batch_size = 2

seq_len = 5

d_k = d_v = 8

# 随机初始化Q, K, V

np.random.seed(42)

Q = np.random.randn(batch_size, seq_len, d_k)

K = np.random.randn(batch_size, seq_len, d_k)

V = np.random.randn(batch_size, seq_len, d_v)

print(f"输入形状:")

print(f" Q (查询): {Q.shape}")

print(f" K (键): {K.shape}")

print(f" V (值): {V.shape}")

# 无掩码注意力

output_no_mask, attn_weights_no_mask = scaled_dot_product_attention(Q, K, V)

print(f"\n无掩码注意力输出形状: {output_no_mask.shape}")

print(f"无掩码注意力权重形状: {attn_weights_no_mask.shape}")

# 因果掩码注意力

causal_mask_matrix = causal_mask(seq_len)

print(f"\n因果掩码矩阵 (seq_len={seq_len}):")

print(causal_mask_matrix)

# 应用因果掩码

output_causal, attn_weights_causal = scaled_dot_product_attention(

Q, K, V, mask=causal_mask_matrix

)

print(f"\n因果注意力输出形状: {output_causal.shape}")

# 可视化注意力权重

def visualize_attention_weights(attn_weights, title, sample_idx=0):

"""可视化注意力权重矩阵"""

plt.figure(figsize=(12, 5))

# 子图1:无掩码注意力

plt.subplot(1, 2, 1)

im1 = plt.imshow(attn_weights_no_mask[sample_idx], cmap='viridis')

plt.colorbar(im1, label='注意力权重')

plt.xlabel('键位置 (j)')

plt.ylabel('查询位置 (i)')

plt.title(f'{title} - 无掩码')

# 添加网格线

plt.grid(True, which='both', color='white', linewidth=0.5, alpha=0.3)

# 子图2:因果掩码注意力

plt.subplot(1, 2, 2)

im2 = plt.imshow(attn_weights_causal[sample_idx], cmap='viridis')

plt.colorbar(im2, label='注意力权重')

plt.xlabel('键位置 (j)')

plt.ylabel('查询位置 (i)')

plt.title(f'{title} - 因果掩码')

# 添加网格线

plt.grid(True, which='both', color='white', linewidth=0.5, alpha=0.3)

plt.tight_layout()

plt.savefig(f'/tmp/attention_weights_{title.lower().replace(" ", "_")}.png',

dpi=150, bbox_inches='tight')

plt.close()

print(f"注意力权重可视化已保存到 /tmp/attention_weights_{title.lower().replace(' ', '_')}.png")

# 运行可视化

visualize_attention_weights(attn_weights_no_mask, "注意力权重", sample_idx=0)

# 分析因果约束的影响

print("\n因果注意力分析:")

print("=" * 60)

# 检查因果约束是否生效

sample_idx = 0

causal_violations = 0

for i in range(seq_len):

for j in range(seq_len):

if j > i and attn_weights_causal[sample_idx, i, j] > 1e-6:

causal_violations += 1

print(f"因果约束检查:")

print(f" 序列长度: {seq_len}")

print(f" 注意力矩阵大小: {seq_len}×{seq_len}")

print(f" 上三角区域(未来位置)数量: {seq_len*(seq_len-1)//2}")

print(f" 因果违反数: {causal_violations}")

print(f" 因果约束: {'通过' if causal_violations == 0 else '失败'}")

# 比较不同位置的注意力模式

print(f"\n不同查询位置的注意力分布 (样本0):")

for i in [0, 2, 4]: # 查看位置0, 2, 4

attention_to_past = attn_weights_causal[sample_idx, i, :i+1].sum() # 只能看到过去

attention_to_self = attn_weights_causal[sample_idx, i, i] # 对自己的关注

print(f" 位置{i}: 总注意力=1.0, 对过去关注={attention_to_past:.3f}, 自我关注={attention_to_self:.3f}")多头注意力实现

class MultiHeadAttention:

"""多头注意力机制"""

def __init__(self, d_model, num_heads):

"""初始化多头注意力

参数:

d_model: 模型维度

num_heads: 注意力头数量

"""

assert d_model % num_heads == 0, "d_model必须能被num_heads整除"

self.d_model = d_model

self.num_heads = num_heads

self.depth = d_model // num_heads

# 线性变换层

self.W_q = np.random.randn(d_model, d_model) * 0.01

self.W_k = np.random.randn(d_model, d_model) * 0.01

self.W_v = np.random.randn(d_model, d_model) * 0.01

self.W_o = np.random.randn(d_model, d_model) * 0.01

def split_heads(self, x, batch_size):

"""将最后一个维度分割为(num_heads, depth)"""

x = x.reshape(batch_size, -1, self.num_heads, self.depth)

return x.transpose(0, 2, 1, 3) # (batch_size, num_heads, seq_len, depth)

def combine_heads(self, x, batch_size):

"""合并注意力头"""

x = x.transpose(0, 2, 1, 3) # (batch_size, seq_len, num_heads, depth)

return x.reshape(batch_size, -1, self.d_model)

def forward(self, q, k, v, mask=None):

"""前向传播"""

batch_size = q.shape[0]

# 线性变换

q = np.matmul(q, self.W_q) # (batch_size, seq_len, d_model)

k = np.matmul(k, self.W_k)

v = np.matmul(v, self.W_v)

# 分割头

q = self.split_heads(q, batch_size) # (batch_size, num_heads, seq_len_q, depth)

k = self.split_heads(k, batch_size) # (batch_size, num_heads, seq_len_k, depth)

v = self.split_heads(v, batch_size) # (batch_size, num_heads, seq_len_v, depth)

# 缩放点积注意力(每个头独立)

scaled_attention, attention_weights = scaled_dot_product_attention(q, k, v, mask)

# 合并头

scaled_attention = self.combine_heads(scaled_attention, batch_size)

# 输出线性变换

output = np.matmul(scaled_attention, self.W_o) # (batch_size, seq_len, d_model)

return output, attention_weights

# 多头注意力演示

print("\n多头注意力演示:")

print("=" * 60)

# 创建多头注意力层

d_model = 64

num_heads = 8

mha = MultiHeadAttention(d_model=d_model, num_heads=num_heads)

print(f"多头注意力配置:")

print(f" 模型维度 (d_model): {d_model}")

print(f" 头数量 (num_heads): {num_heads}")

print(f" 每个头维度 (depth): {d_model // num_heads}")

print(f" 总参数数: {4 * d_model * d_model}") # W_q, W_k, W_v, W_o

# 测试数据

batch_size = 3

seq_len = 10

test_q = np.random.randn(batch_size, seq_len, d_model)

test_k = np.random.randn(batch_size, seq_len, d_model)

test_v = np.random.randn(batch_size, seq_len, d_model)

print(f"\n测试数据形状:")

print(f" Q: {test_q.shape}")

print(f" K: {test_k.shape}")

print(f" V: {test_v.shape}")

# 前向传播(无掩码)

output_mha, attn_weights_mha = mha.forward(test_q, test_k, test_v)

print(f"\n多头注意力输出形状: {output_mha.shape}")

print(f"注意力权重形状: {attn_weights_mha.shape} # (batch_size, num_heads, seq_len, seq_len)")

# 可视化不同头的注意力模式

def visualize_multihead_attention(attn_weights, title, sample_idx=0):

"""可视化多头注意力的不同头"""

num_heads = attn_weights.shape[1]

seq_len = attn_weights.shape[2]

fig, axes = plt.subplots(2, 4, figsize=(16, 8))

axes = axes.flatten()

for h in range(min(num_heads, 8)): # 最多显示8个头

ax = axes[h]

im = ax.imshow(attn_weights[sample_idx, h], cmap='viridis', vmin=0, vmax=1)

ax.set_xlabel('键位置')

ax.set_ylabel('查询位置')

ax.set_title(f'头 {h+1}')

ax.grid(True, which='both', color='white', linewidth=0.5, alpha=0.3)

# 移除多余的子图

for h in range(min(num_heads, 8), 8):

axes[h].axis('off')

plt.suptitle(f'{title} - 多头注意力模式 (样本{sample_idx})', fontsize=14)

plt.tight_layout()

plt.savefig(f'/tmp/multihead_attention_{title.lower().replace(" ", "_")}.png',

dpi=150, bbox_inches='tight')

plt.close()

print(f"多头注意力可视化已保存到 /tmp/multihead_attention_{title.lower().replace(' ', '_')}.png")

# 运行可视化

visualize_multihead_attention(attn_weights_mha, "多头注意力", sample_idx=0)

# 分析不同头的注意力多样性

print("\n多头注意力多样性分析:")

print("=" * 60)

sample_idx = 0

head_diversity = np.zeros((num_heads, num_heads))

# 计算头之间的相似度

for i in range(num_heads):

for j in range(num_heads):

if i != j:

# 计算两个头注意力权重的余弦相似度

head_i = attn_weights_mha[sample_idx, i].flatten()

head_j = attn_weights_mha[sample_idx, j].flatten()

similarity = np.dot(head_i, head_j) / (np.linalg.norm(head_i) * np.linalg.norm(head_j))

head_diversity[i, j] = similarity

print(f"多头注意力头间平均相似度: {np.mean(head_diversity[np.triu_indices(num_heads, k=1)]):.4f}")

print(f"多头注意力头间最小相似度: {np.min(head_diversity[np.triu_indices(num_heads, k=1)]):.4f}")

print(f"多头注意力头间最大相似度: {np.max(head_diversity[np.triu_indices(num_heads, k=1)]):.4f}")

print(f"\n解释:")

print(f" 相似度接近1: 头之间关注相似模式")

print(f" 相似度接近0: 头之间关注不同模式")

print(f" 多样性高(相似度低)通常更好,表示不同头捕捉不同特征")LSTM与注意力的比较实验

def compare_lstm_vs_attention():

"""比较LSTM与注意力在简单任务上的表现"""

# 创建一个简单的序列复制任务

def create_copy_task_data(num_samples, seq_len, vocab_size=10):

"""创建序列复制任务数据"""

X = np.zeros((num_samples, seq_len, vocab_size))

y = np.zeros((num_samples, seq_len, vocab_size))

for i in range(num_samples):

# 生成随机序列

sequence = np.random.randint(0, vocab_size-1, seq_len//2)

# 输入:分隔符 + 序列

for t in range(seq_len//2):

X[i, t, sequence[t]] = 1 # 序列部分

X[i, seq_len//2, vocab_size-1] = 1 # 分隔符

# 输出:空白 + 序列(延迟复制)

for t in range(seq_len//2 + 1, seq_len):

y[i, t, sequence[t - seq_len//2 - 1]] = 1

return X, y

print("LSTM vs 注意力比较实验(序列复制任务):")

print("=" * 60)

# 生成数据

seq_len = 20

vocab_size = 10

X_train, y_train = create_copy_task_data(1000, seq_len, vocab_size)

X_test, y_test = create_copy_task_data(200, seq_len, vocab_size)

print(f"任务描述: 复制前半段序列到后半段")

print(f"序列长度: {seq_len} (前半段{seq_len//2} + 分隔符 + 后半段{seq_len//2-1})")

print(f"词汇表大小: {vocab_size}")

print(f"训练样本: {X_train.shape[0]}, 测试样本: {X_test.shape[0]}")

# 简单的LSTM模型

class SimpleLSTMModel:

def __init__(self, input_size, hidden_size, output_size):

self.lstm_cell = LSTMCell(input_size, hidden_size)

self.W_out = np.random.randn(hidden_size, output_size) * 0.01

self.b_out = np.zeros((1, output_size))

self.hidden_size = hidden_size

def forward(self, X):

"""前向传播整个序列"""

batch_size, seq_len, input_size = X.shape

h = np.zeros((batch_size, self.hidden_size))

c = np.zeros((batch_size, self.hidden_size))

outputs = []

for t in range(seq_len):

h, c, _ = self.lstm_cell.forward(X[:, t, :], h, c)

output_t = np.matmul(h, self.W_out) + self.b_out

outputs.append(output_t)

return np.stack(outputs, axis=1) # (batch_size, seq_len, output_size)

# 简单的注意力模型

class SimpleAttentionModel:

def __init__(self, input_size, d_model):

self.d_model = d_model

self.W_q = np.random.randn(input_size, d_model) * 0.01

self.W_k = np.random.randn(input_size, d_model) * 0.01

self.W_v = np.random.randn(input_size, d_model) * 0.01

self.W_out = np.random.randn(d_model, input_size) * 0.01

self.b_out = np.zeros((1, input_size))

def forward(self, X):

"""前向传播(使用因果注意力)"""

batch_size, seq_len, input_size = X.shape

# 线性变换得到Q, K, V

Q = np.matmul(X, self.W_q) # (batch_size, seq_len, d_model)

K = np.matmul(X, self.W_k)

V = np.matmul(X, self.W_v)

# 因果注意力

causal_mask_matrix = causal_mask(seq_len)

output, _ = scaled_dot_product_attention(Q, K, V, mask=causal_mask_matrix)

# 输出层

output = np.matmul(output, self.W_out) + self.b_out

return output

# 训练函数(简化版,演示目的)

def train_model_simple(model, X, y, epochs=10, lr=0.01):

"""简化训练函数(演示目的)"""

losses = []

for epoch in range(epochs):

# 前向传播

predictions = model.forward(X)

# 计算损失(交叉熵)

exp_pred = np.exp(predictions - np.max(predictions, axis=-1, keepdims=True))

probs = exp_pred / np.sum(exp_pred, axis=-1, keepdims=True)

loss = -np.mean(y * np.log(probs + 1e-8))

losses.append(loss)

if epoch % 5 == 0:

# 计算准确率

pred_labels = np.argmax(predictions, axis=-1)

true_labels = np.argmax(y, axis=-1)

accuracy = np.mean(pred_labels == true_labels)

print(f" 轮数 {epoch}: 损失={loss:.4f}, 准确率={accuracy:.2%}")

return losses, predictions

# 训练和比较

hidden_size = 32

d_model = 32

print("\n训练LSTM模型:")

lstm_model = SimpleLSTMModel(input_size=vocab_size, hidden_size=hidden_size, output_size=vocab_size)

lstm_losses, lstm_preds = train_model_simple(lstm_model, X_train[:100], y_train[:100], epochs=20)

print("\n训练注意力模型:")

attention_model = SimpleAttentionModel(input_size=vocab_size, d_model=d_model)

attn_losses, attn_preds = train_model_simple(attention_model, X_train[:100], y_train[:100], epochs=20)

# 可视化比较

plt.figure(figsize=(10, 6))

plt.plot(lstm_losses, 'b-', linewidth=2, label='LSTM')

plt.plot(attn_losses, 'r-', linewidth=2, label='注意力')

plt.xlabel('训练轮数')

plt.ylabel('交叉熵损失')

plt.title('LSTM vs 注意力在序列复制任务上的训练曲线')

plt.legend()

plt.grid(True, alpha=0.3)

plt.savefig('/tmp/lstm_vs_attention_training.png', dpi=150, bbox_inches='tight')

plt.close()

print(f"\n训练曲线已保存到 /tmp/lstm_vs_attention_training.png")

# 分析模型行为

print("\n模型行为分析:")

print("=" * 60)

# 测试一个样本

test_sample_idx = 0

lstm_test_pred = lstm_model.forward(X_test[test_sample_idx:test_sample_idx+1])

attn_test_pred = attention_model.forward(X_test[test_sample_idx:test_sample_idx+1])

# 解码序列

def decode_sequence(one_hot_seq):

"""解码one-hot序列为索引"""

return np.argmax(one_hot_seq, axis=-1)

input_seq = decode_sequence(X_test[test_sample_idx])

target_seq = decode_sequence(y_test[test_sample_idx])

lstm_pred_seq = decode_sequence(lstm_test_pred[0])

attn_pred_seq = decode_sequence(attn_test_pred[0])

print(f"输入序列: {input_seq}")

print(f"目标序列: {target_seq}")

print(f"LSTM预测: {lstm_pred_seq}")

print(f"注意力预测: {attn_pred_seq}")

# 计算准确率

lstm_acc = np.mean(lstm_pred_seq == target_seq)

attn_acc = np.mean(attn_pred_seq == target_seq)

print(f"\n单个样本准确率:")

print(f" LSTM: {lstm_acc:.2%}")

print(f" 注意力: {attn_acc:.2%}")

# 任务分析

print(f"\n任务难度分析:")

print(f" - 序列复制需要记住前半段序列,在后半段重现")

print(f" - 关键挑战: 长期依赖(需要跨越分隔符回忆)")

print(f" - LSTM优势: 通过细胞状态保持记忆")

print(f" - 注意力优势: 直接访问历史信息")

print(f" - 预期: 注意力可能在这个任务上表现更好")

# 运行比较实验

compare_lstm_vs_attention()兔狲教授总结道,"LSTM与注意力的较量不是胜负之争,而是哲学对话。LSTM代表渐进式记忆的智慧——信息在时间中慢慢沉淀、筛选、更新。注意力代表直接访问的革命——根据需要瞬间提取相关信息。最重要的是,这场较量教会我们:好的架构设计源于对问题本质的深刻理解,而不是盲目追随技术潮流。在这条路上,思考比代码更重要,理解比实现更有价值。"

兔狲教授的思考题

实践探索(适合小小猪)

- 注意力变体实验:实现不同的注意力变体(如局部注意力、稀疏注意力)。比较它们与全注意力的计算效率和效果差异?

- 混合架构设计:设计一个LSTM+注意力的混合模型。让LSTM处理局部模式,注意力捕捉长距离依赖。效果如何?

- 注意力可视化:在真实文本数据上训练注意力模型,可视化注意力权重。模型关注哪些词?为什么?

历史探究(适合小海豹)

- 注意力机制的起源:研究注意力机制在神经科学和心理学中的起源。它如何从认知概念转化为计算工具?

- Transformer革命:调查2017年《Attention Is All You Need》论文的历史背景。为什么这篇论文引发了AI革命?

- 架构演进史:绘制从简单RNN到LSTM到Transformer的架构演进时间线。每次突破解决了什么核心问题?

综合思考

- 哲学反思:LSTM的"渐进遗忘"与注意力的"完美记忆"反映了什么不同的认识论?在人类认知中,我们更接近哪种模式?

- 伦理挑战:注意力机制让模型能够"关注"输入的不同部分。这带来了可解释性优势,但也可能被用于操纵关注点。如何确保注意力公平?

- 创造练习:设计一个"可学习遗忘"机制,让模型能够动态调整遗忘速率。你会如何设计这个机制?

- 极限挑战:证明注意力机制可以模拟任何LSTM(理论上)。这需要多少头?多少层?说明了什么?

下一步预告

茶香在黑石屋中弥漫,夜色深沉。

"今天我们探索了遗忘与因果的较量,"兔狲教授说,"看到了两种记忆哲学的碰撞。但注意力机制不止于此——它如何让模型学会'该看哪'?"

小小猪好奇地问:"'该看哪'?就像……在复杂场景中选择关注点?"

"是的,"兔狲教授解释,"下一章,我们要深入探索注意力:在这个嘈杂的世界里,该看哪? 理解注意力如何成为现代AI的'眼睛'。"

小海豹翻动着笔记本,"这引出了感知与认知的核心问题。历史上,注意力机制如何从计算机视觉发展到自然语言处理?"

兔狲教授微笑:"我们慢慢来,下一章见。"

小小猪的笔记:我实现了注意力机制并与LSTM比较。在序列复制任务上,注意力确实更快学会长距离依赖!但我也发现,注意力权重矩阵很大(序列长度平方),对于长序列确实有计算代价。最有趣的是多头注意力——不同头确实关注不同模式,有的关注局部,有的关注全局。

小海豹的笔记:研究了注意力机制的历史,惊讶于它的多学科起源。在心理学中,William James早在1890年就系统研究注意力。在计算机视觉中,注意力机制最初用于图像处理。Transformer论文的简洁性令人震撼——完全基于注意力,不需要RNN/CNN,却更强大。简洁的力量。

兔狲教授的结语:LSTM与注意力的较量教给我们关于智能设计的深刻一课:没有绝对的最优,只有合适的权衡。渐进式记忆适合时间流,直接访问适合结构化关系。最重要的是,它提醒我们:技术进步不是替代,而是丰富我们的工具箱。在这条路上,多样性比单一性更重要,理解比应用更有价值。我们慢慢来,理解了最重要。