第6章:一致性

编辑:赵志民,王茂霖,詹好

本章前言

本章内容主要探讨学习理论中的一致性(Consistency),研究随着训练数据的增加,通过学习算法所获得的分类器是否逐渐逼近贝叶斯最优分类器。具体内容包括一致性的定义、参数方法下的一致性分析、非参数方法下的一致性分析,以及随机森林一致性分析的案例。

6.1 【证明补充】泛化风险的无偏估计

117页中,公式(6.25)给出了分类器的经验风险

首先,需要理解经验风险

其次,当我们说

泛化风险定义为:

经验风险定义为:

现在我们证明经验风险是泛化风险的无偏估计:

假设所有样本都是从一个未知的样本-标签空间

6.2 【证明补充】替代函数一致性

120页的定理6.1给出了替代一致性的充分条件。首先,我们推导了泛化风险与贝叶斯风险之间的差异不等式。根据一致性的定义,我们需要证明,当

为此,我们进一步构造了关于

因此,当

其中,不等式(6.40)的推导涉及一定的构造技巧,接着通过定理中的条件推导出不等式(6.43)。利用所构造的凸函数的性质,最终完成了这一证明。

6.3 【概念解释】划分机制方法

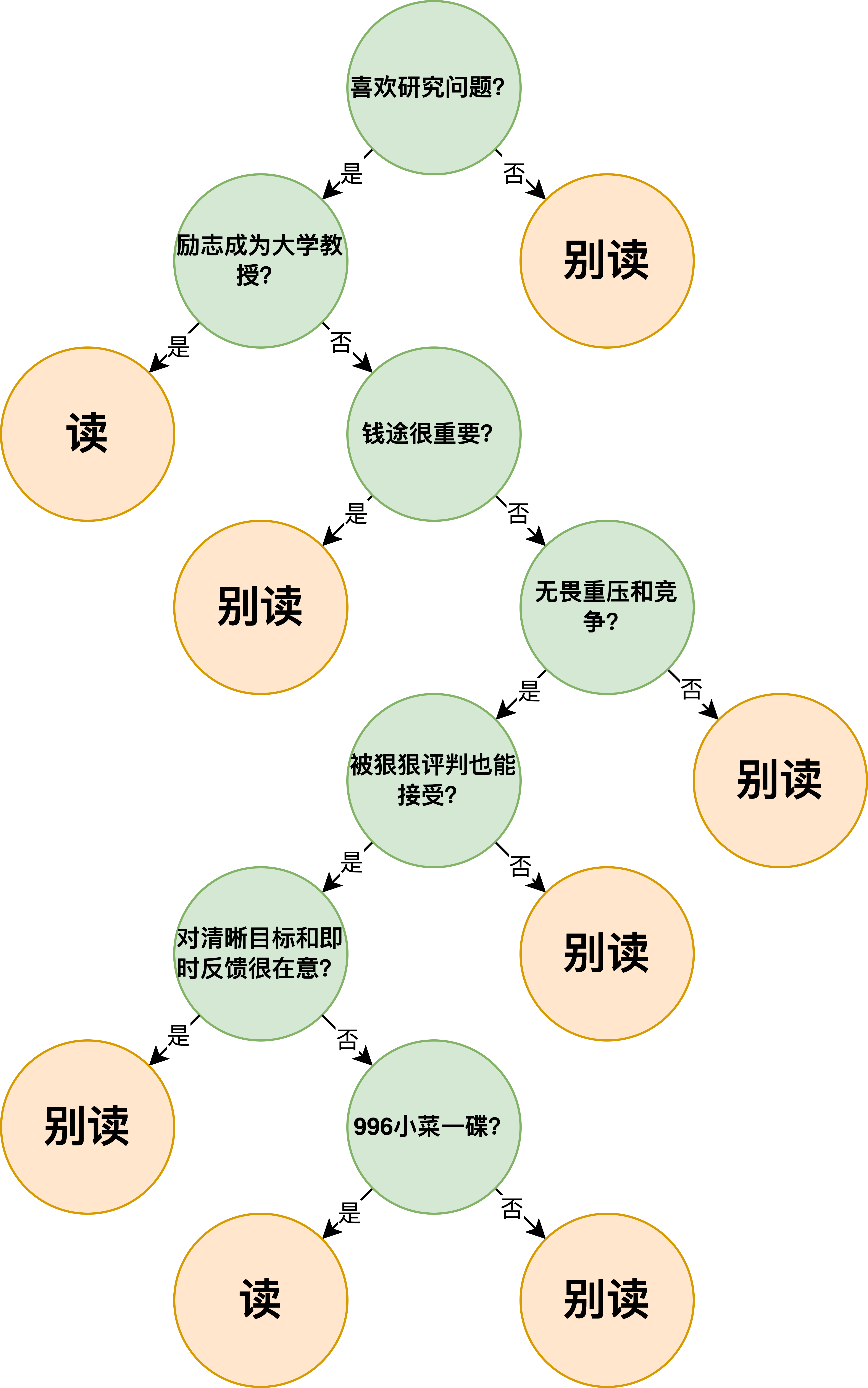

122页介绍了一种将样本空间划分成多个互不相容区域的方法,然后对各区域内的正例和反例分别计数,并以多数类别作为区域中样本的标记。这种方法本质上不同于参数方法,它并不是在参数空间中进行搜索构建划分超平面,而是在泛函空间上直接进行搜索。一个典型的例子是我们熟悉的决策树模型:

每当构造一个决策树的节点时,相当于在样本空间上进行了一次划分(即划分机制)。这种洞察方式同样适用于解释剪枝操作,即通过减少不必要的节点来简化树结构,同时保持或提高模型的性能。

6.4 【概念解释】依概率成立

124页的定理6.2提到一个定义——依概率成立(Almost Sure)。这是概率论与数理统计中的一个概念,表达如下:

和对于所有

它意味着当

6.5 【证明补充】划分机制一致性

124页的定理6.2给出了划分一致性的充分条件。首先我们定义了

再根据划分机制构造分类器(输出函数)

在此,我们利用了基于条件概率估计的插值法,并借助引理6.2得到了输出函数的泛化风险与贝叶斯风险之间的差值不等式。对于不等式右侧的期望,利用三角不等式进行放缩,可得(6.62)。

根据假设条件:

由于

这是由于

接下来,针对三角不等式右式的前半部分,将其拆分为

然后,对于不等式右侧的第二部分,利用引理6.3的不等式,可以得到:

对于此不等式的右侧,再进行放缩。对于任意

结合前面的结果,我们可以得出:

根据

最终证明了其输出函数的泛化风险在

6.6 【证明补充】随机森林的划分一致性

130页中的定理6.5提到了一种简化版本的随机森林,即每次划分都是均匀随机的,并不依赖于训练集的标签。以下对证明直径

首先,令

对于

令

由于每个属性的边长

综合以上各式,我们只需证明当

令随机变量

令

此时,只需证明当

每次划分节点都会增加一个新节点,且每次选择节点进行划分的概率均为

由于