第7章:复杂度的真相:不是快慢,是结构

P≠NP(如果成立)告诉我们的不是”有些问题很难”,而是”宇宙本身有某种不对称性”。

一、一个不对称

2023年,当DeepSeek-R1和GPT-4在各种推理任务上刷新记录时,研究者们开始测试它们在NP完全问题上的表现。结果令人震惊。

[Zixi Li, 2025a]设计了OpenXOR测试——一个基于约束满足的诊断工具。任务很简单:给定一组XOR约束(异或关系),判断是否存在满足所有约束的赋值。这是一个标准的NP完全问题。

测试结果令人震惊。DeepSeek-R1的任务完成率是0%。GPT-4的任务完成率也是0%。而一个只有100k参数的符号求解器OpenLM,准确率达到了76%。

注意,这不是0%准确率,而是0%任务完成率——模型要么拒绝回答(37-42%),要么触碰上下文限制(28-31%),要么产生幻觉约束(18-22%)。它们甚至没有尝试去解决问题。

这个结果揭示了一个深刻的事实:规模不是问题的关键,架构才是。

让我们从最基础的地方开始理解这个不对称。

二、验证与搜索:一个简单的实验

拿出一张纸,写下这个3-SAT实例:

(x₁ ∨ ¬x₂ ∨ x₃) ∧ (¬x₁ ∨ x₂ ∨ ¬x₄) ∧ (x₂ ∨ x₃ ∨ x₄) ∧ (¬x₁ ∨ ¬x₃ ∨ x₄)

现在我告诉你一个候选解:x₁=真, x₂=假, x₃=真, x₄=真。

验证它是否满足所有子句:

第一个子句:x₁=真,满足。

第二个子句:¬x₁=假,x₂=假,¬x₄=假… 等等,这个子句不满足。

所以这不是一个解。整个验证过程花了你多久?10秒?20秒?

现在,不看答案,从零开始找一个满足所有子句的赋值。

你可能会尝试:

x₁=真, x₂=真, x₃=真, x₄=真 检查 不满足

x₁=真, x₂=真, x₃=真, x₄=假 检查 不满足

x₁=真, x₂=真, x₃=假, x₄=真 检查 不满足

…

4个变量有2⁴=16种可能。如果运气不好,你可能需要尝试所有16种才能找到解(或确认无解)。

这就是验证与搜索的不对称。验证一个候选解需要O(m)时间,m是子句数量,线性时间。但搜索一个解需要O(2ⁿ × m)时间,n是变量数量,指数时间。

当n=10时,搜索空间是1024。当n=100时,搜索空间是2¹⁰⁰

这不是工程问题,这是数学事实。

三、自己动手:体验指数墙

让我们做一个更直观的实验。

步骤1:构造一个小规模3-SAT实例

变量:x₁, x₂, x₃, x₄(4个布尔变量)

子句:

(x₁ ∨ ¬x₂ ∨ x₃)

(¬x₁ ∨ x₂ ∨ ¬x₄)

(x₂ ∨ x₃ ∨ x₄)

(¬x₁ ∨ ¬x₃ ∨ x₄)

步骤2:验证一个候选解

给定赋值:x₁=T, x₂=F, x₃=T, x₄=T

逐个检查子句(每个子句至少一个文字为真即可):

子句1:x₁=T,满足

子句2:x₂=F,满足

子句3:x₂=F, x₃=T,满足

子句4:¬x₁=F, ¬x₃=F, x₄=T,满足

验证通过!用时:O(4)=常数时间。

步骤3:搜索所有可能解

现在不看答案,枚举2⁴=16种赋值:

from itertools import product

# 定义4变量3-SAT实例

# 每个子句是一个文字列表;正数 i 表示 x_i,负数 -i 表示 ¬x_i

clauses = [

[1, -2, 3], # (x₁ ∨ ¬x₂ ∨ x₃)

[-1, 2, -4], # (¬x₁ ∨ x₂ ∨ ¬x₄)

[2, 3, 4], # (x₂ ∨ x₃ ∨ x₄)

[-1, -3, 4], # (¬x₁ ∨ ¬x₃ ∨ x₄)

]

def check_clause(clause, assignment):

"""检查单个子句是否满足:至少一个文字为真"""

for lit in clause:

# lit > 0 表示正文字,lit < 0 表示否定文字

val = assignment[abs(lit) - 1]

if (lit > 0 and val) or (lit < 0 and not val):

return True

return False

def check_sat(clauses, assignment):

"""检查所有子句是否同时满足"""

return all(check_clause(c, assignment) for c in clauses)

# 枚举所有 2^4 = 16 种赋值(False=0, True=1)

print(f"{'x₁':^5}{'x₂':^5}{'x₃':^5}{'x₄':^5}{'满足?':^8}")

print("-" * 35)

solutions = []

for bits in product([False, True], repeat=4):

sat = check_sat(clauses, bits)

mark = "是" if sat else "否"

vals = ["T" if b else "F" for b in bits]

print(f"{vals[0]:^5}{vals[1]:^5}{vals[2]:^5}{vals[3]:^5}{mark:^8}")

if sat:

solutions.append(bits)

print(f"\n共找到 {len(solutions)} 个满足赋值:")

for sol in solutions:

print(" ", {f"x{i+1}": ("T" if v else "F") for i, v in enumerate(sol)})体验指数增长:

5个变量 32种赋值

10个变量 1024种赋值

20个变量 1,048,576种赋值

步骤4:思考题

如果变量数增加到100,穷举需要多久?

假设每秒检查10⁹个赋值(现代CPU的速度),需要:

宇宙年龄是138亿年。你需要宇宙年龄的万分之一来解决一个100变量的3-SAT实例。

这就是指数墙。

四、相变:问题最难的地方

但并非所有3-SAT实例都一样难。

这听起来像是废话。当然不一样难——10个变量的实例比100个变量的实例简单。但我说的不是这个。

我说的是:即使变量数量相同,不同的3-SAT实例,难度也可能天差地别。而这个差别,不是随机的,而是有规律的。

考虑两个极端。第一个极端是欠约束的情况:10个变量,20个子句,子句密度

第二个极端是过约束的情况:10个变量,80个子句,子句密度

这两个极端都不难。

但在

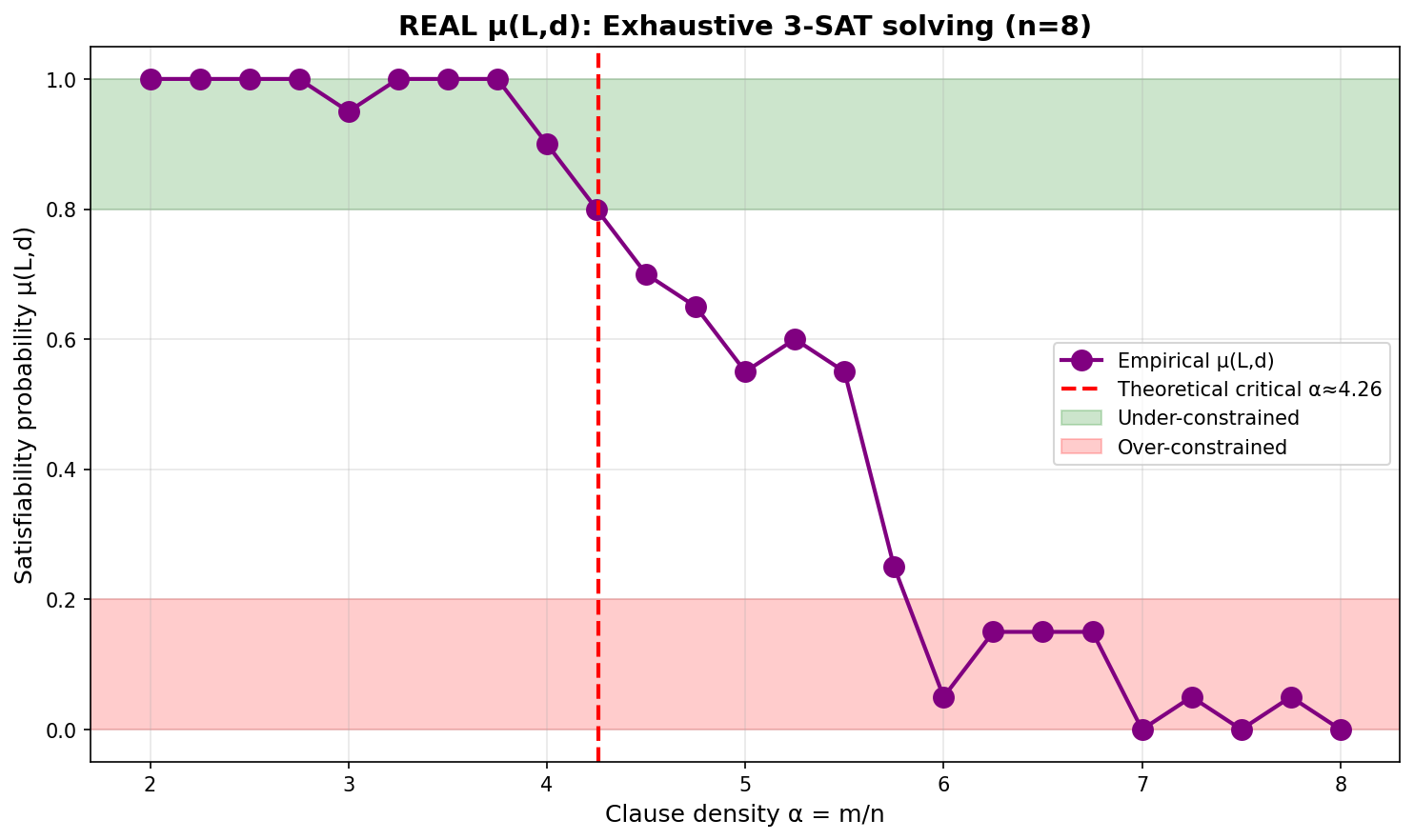

[Xu & Li, 2000]在2000年的开创性工作中发现:当子句密度

它在

从接近1,骤降到接近0。不是渐进的衰减,而是断崖式的坠落。

这不是第一次在计算问题里看到相变。但每次看到,都让人不安。因为这意味着,问题的性质在某个临界点发生了质的改变。就像水在0°C从固态变为液态,磁铁在居里温度失去磁性,3-SAT在

更重要的是,这个相变点恰好是问题最难求解的地方。

横轴是子句密度

横轴是子句密度

为什么临界点最难?

让我先说两个极端的情况。

在欠约束区,解的数量很多。随机搜索很容易碰到一个。求解器不需要太聪明,只需要运气不太差。

在过约束区,矛盾很快暴露。求解器走几步就发现”这条路不通”,回溯,剪枝,换一条路。虽然最终证明无解,但这个过程很快。

但在临界点,求解器陷入了一个微妙的平衡。

解的数量很少,但不是零。所以你不能放弃搜索。矛盾不够明显,所以回溯树变得巨大。搜索空间既不稀疏也不密集,恰好处于最难导航的状态——你既找不到捷径,也无法快速排除错误的方向。

这是一种最糟糕的困境。

[Zhan, 2026]用离散几何模型解释了这个现象。他将3-SAT映射到N维布尔超立方体的组合拓扑,推导出最小不可满足极限为

这解释了为何可满足性阈值猜想仅”几乎必然”成立——在有限规模下,相变不是绝对的,而是概率性的。

五、μ(L,d):将离散边界连续化

传统复杂度理论的问题在于,它只告诉我们一个问题”属于”P还是NP,却无法量化一个具体实例有多难。

3-SAT是NP完全的——这是一个二元判决。但这不意味着所有3-SAT实例都一样难。一个10变量、20子句的实例和一个100变量、420子句的实例,难度天差地别。

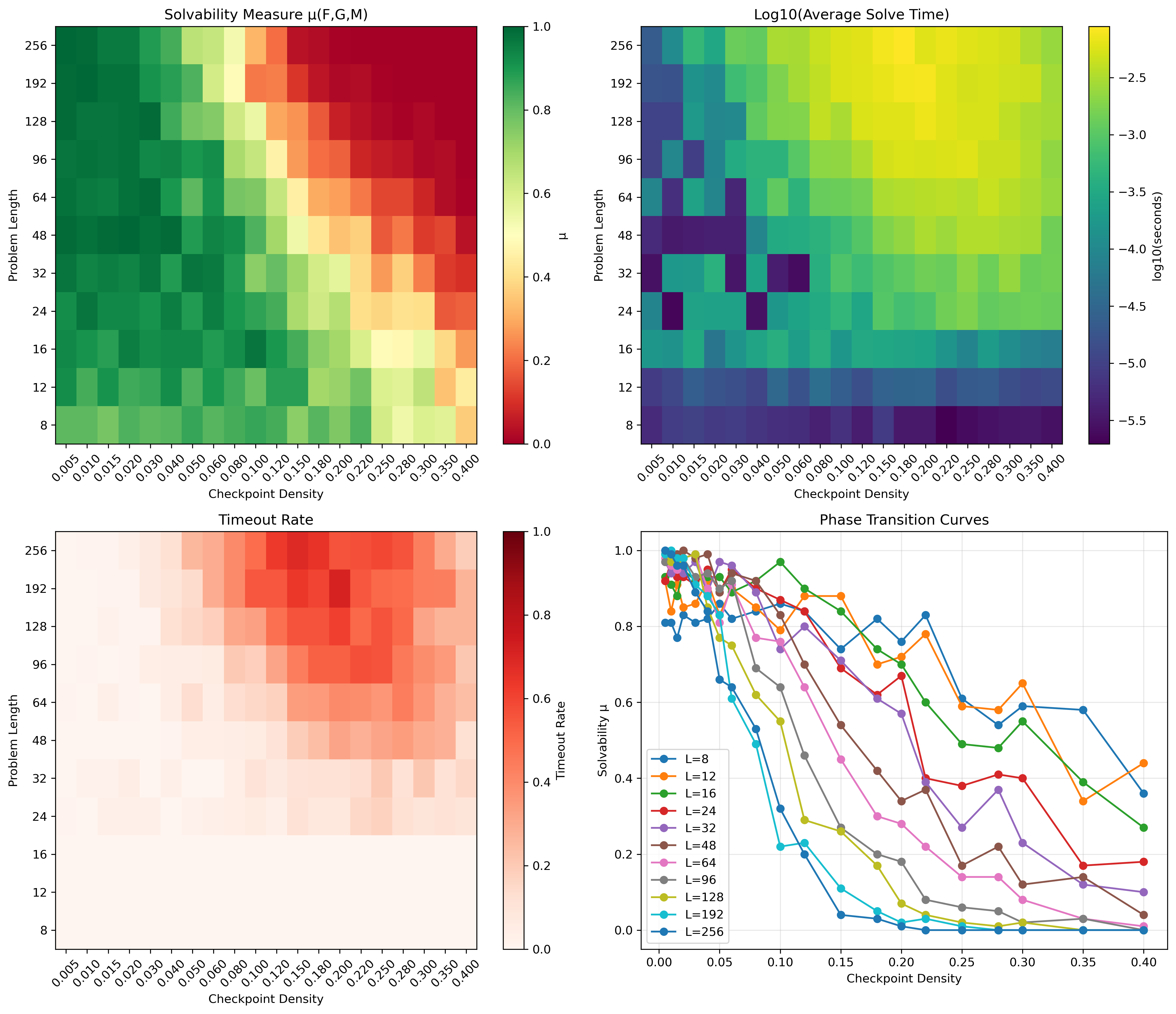

[Zixi Li, 2025a]的OpenXOR框架突破了这个限制。它将NP问题的可解性从二元判决转化为连续相图。

对于规模L、约束密度d的实例,定义可解概率μ(L,d):

其中临界约束密度满足对数标度律:

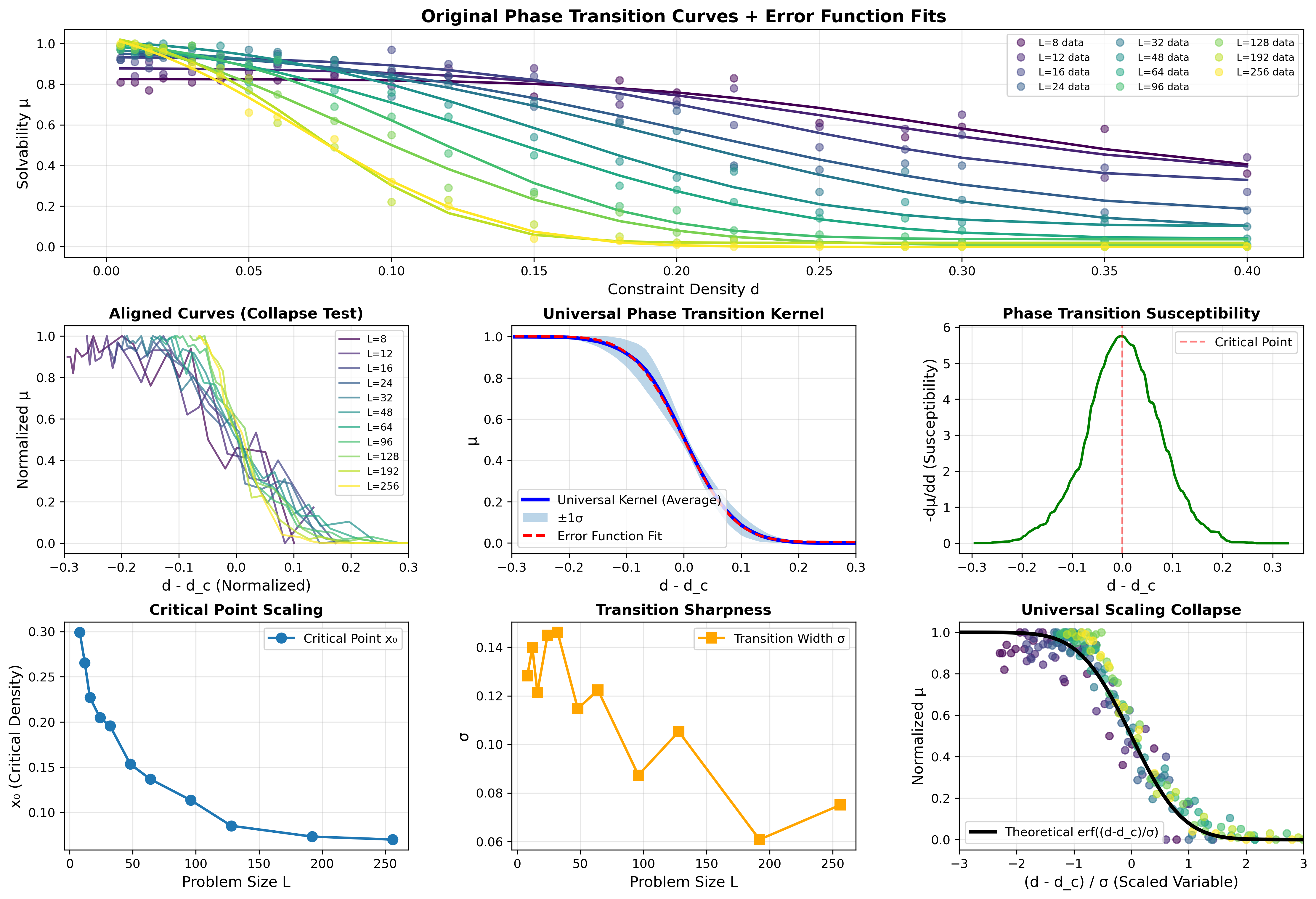

这个公式的美妙之处在于三点。第一,普适性:所有不同规模的相变曲线坍缩为单一核函数。第二,可预测性:给定L和d,可以预测可解概率,无需实际求解。第三,连续性:

实验验证:在22,000个OpenXOR实例上,这个公式的均方误差MSE~10⁻³。

OpenXOR相图:横轴是约束密度d,纵轴是问题规模L。颜色表示可解概率

OpenXOR相图:横轴是约束密度d,纵轴是问题规模L。颜色表示可解概率

所有不同规模的相变曲线坍缩为单一误差函数核。这个普适性表明,相变的”形状”是规模无关的,只有临界点位置随ln(L)移动。

所有不同规模的相变曲线坍缩为单一误差函数核。这个普适性表明,相变的”形状”是规模无关的,只有临界点位置随ln(L)移动。

这揭示了一个哲学转变:可计算性不是二元的,而是概率性的。

NP不是一堵墙,而是一片有梯度的雾。在雾的边缘(

六、NP完全性:Cook-Levin定理与归约

P vs NP 是一个存在性问题——我们不知道答案。但在这个问题悬而未决的情况下,数学家做了一件聪明的事:证明某些问题"和所有NP问题一样难"。

这就是 NP 完全性。

6.1 Cook-Levin定理:SAT是NP完全的

1971年,Stephen Cook(和独立工作的 Leonid Levin)证明了一个惊人的定理:

SAT(布尔可满足性问题)是 NP 完全的。

SAT 问的是:给定一个布尔公式(AND/OR/NOT 组成的逻辑表达式),是否存在一组变量赋值使它为真?

比如:

是否存在

Cook-Levin 定理说的是两件事:

第一,SAT 属于 NP:给定一组赋值,验证它是否满足公式,只需要

第二,所有 NP 问题都可以归约到 SAT:对于任意 NP 问题

这个归约方向是关键:不是说 SAT 和

如果有人发明了多项式时间的 SAT 算法,那他同时解决了所有 NP 问题。

6.2 多项式归约:难度的传递

NP 完全性的核心工具是多项式时间归约(polynomial-time reduction)。

问题

存在一个多项式时间算法

,使得 。

直觉:如果你能解

归约链:Cook 证明了 SAT 是 NP 完全的。此后,Karp(1972)给出了21个经典问题的归约链:

每一步归约都证明了新问题是 NP 完全的。

这个归约链有一个哲学意义:这些看起来毫无关联的问题,在计算难度上是等价的。图论、组合优化、逻辑推理……它们底层共享同一种"难度结构"。

6.3 为什么这对推理有意义

NP 完全性告诉我们:

如果 P≠NP,那么不存在通用的高效推理算法。

定理证明、计划问题、约束满足……这些推理任务大多是 NP 完全的。这意味着:

- 精确算法在最坏情况下是指数级的

- 启发式(第8章)和近似算法(也是第8章)是唯一实际可行的路径

- 没有任何算法能同时做到:通用、高效、精确

这三者,你只能选两个。这不是工程限制,是数学定理。

七、停机问题:计算的根本禁区

如果说P vs NP是关于”难度”的问题,那么停机问题则是关于”可能性”的问题。

它不是说某些问题很难解决,而是说某些问题根本无法解决。

停机问题问的是:给定一个程序P和它的输入x,能否判断P(x)是否会停机(而不是无限循环)?

图灵在1936年用对角化论证证明了这个问题不可判定。让我们重现这个证明。

假设:存在一个停机判定器H(P, x),它能判断程序P在输入x上是否停机。

构造:定义一个新程序D:

矛盾:现在问D(D)会停机吗?

如果H(D, D)返回”停机”,那么D(D)会进入无限循环,不停机

如果H(D, D)返回”不停机”,那么D(D)会立即返回,停机

无论哪种情况,H的判断都是错的。所以H不可能存在。

这个证明的深刻之处不在于技巧,而在于它揭示的结构性限制。

停机问题不可判定,不是因为: - 我们还没找到足够聪明的算法 - 计算机还不够快 - 我们需要更多内存

而是因为任何算法都无法解决它。这是逻辑必然,不是技术限制。

[Hamkins & Nenu, 2024]对图灵原始论文进行了细致的历史分析。他们指出,虽然图灵1936年的论文确实包含了不可判定性的核心思想,但现代形式的停机问题表述是后来逐步完善的。这提醒我们,即使是最基础的理论结果,其历史演化也比我们想象的复杂。

停机问题划定了计算的终极边界。在这个边界之外,不是”难”,而是”不可能”。

八、复杂度的哲学意义

复杂度理论告诉我们的不仅仅是”哪些问题难”,而是宇宙的计算结构。

P vs NP问的是:验证与搜索之间的不对称性是本质的吗?如果P≠NP成立,那意味着宇宙中存在一种根本的不对称——知道答案比找到答案容易,而且这个差距无法被任何算法弥补。

这不是技术问题,而是关于知识本质的问题。为什么验证比发现容易?为什么理解比创造容易?这个不对称性暗示了什么?

相变核函数μ(L,d)则告诉我们,这个不对称不是绝对的,而是渐进的。在相变点附近,问题处于可解与不可解的临界状态。微小的参数变化就能导致质的飞跃——从”几乎总可解”到”几乎总不可解”。

停机问题则划定了计算的终极边界。有些问题不是”难”,而是”不可能”。这不是技术限制,而是逻辑必然。任何足够强大的计算系统都会遇到这个边界。

有些问题太难,不可能精确求解。下一章,我们将看到启发式算法如何用"明确代价的近似"绕开这堵墙——以及这个近似需要遵守什么契约。

悬而未决

P≠NP能被证明吗? 还是它本身就是一个不可判定命题?如果P≠NP不可证明,那意味着什么?

相变核函数能否推广? μ(L,d)框架能否推广到其他复杂度类,如PSPACE、EXP?不同问题的相变是否遵循统一的数学结构?

自然界的计算相变 蛋白质折叠、神经网络训练、生物进化——这些自然计算过程是否也遵循类似的相变规律?

LLM的架构缺陷 为什么100k参数的符号求解器能达到76%准确率,而千亿参数的LLM却0%任务完成率?差距在哪里?

延伸阅读

[Zixi Li, 2025a] — QMCB/OpenXOR, NP可解性连续相图

[Xu & Li, 2000] — 3-SAT相变的开创性工作

[Zhan, 2026] — 3-SAT的离散几何模型

[Istrate, 2000] — 计算复杂性与相变的理论联系

[Hamkins & Nenu, 2024] — 停机问题的历史澄清